- La souveraineté numérique est à portée de main grâce aux LLM open source.

- Votre PC Linux peut devenir un puissant serveur d'IA locale.

- Choisir le bon modèle et optimiser ses ressources est crucial.

- Des outils comme Ollama simplifient grandement le déploiement.

Pourquoi déployer localement en 2026 ? L'ère de la souveraineté numérique.

Il y a deux ou trois ans, l'idée de faire tourner un LLM de taille respectable sur un PC personnel relevait presque de la science-fiction pour le commun des mortels. Mais nous sommes en 2026, et la technologie a fait des pas de géant ! Non seulement nos machines sont devenues plus puissantes – merci aux cartes graphiques toujours plus performantes avec une VRAM généreuse – mais surtout, les modèles open source ont atteint une maturité et une qualité impressionnantes. Pensez à des modèles comme Mixtral 8x22B et ses successeurs directs, ou les versions affinées des Llama 3 et Llama 4 (si les rumeurs sont fondées !), qui rivalisent sans rougir avec leurs homologues propriétaires. Mais au-delà de la prouesse technique, il y a une raison encore plus profonde qui me pousse vers le local : la souveraineté numérique. Qui n'a jamais froncé les sourcils en se demandant où allaient vraiment ses données quand on utilise une IA dans le cloud ? Les entreprises sont de plus en plus conscientes des enjeux de confidentialité et de conformité (RGPD, tout ça...). En déployant un LLM sur votre propre serveur Linux, vous gardez un contrôle total. Vos requêtes, vos données, tout reste chez vous, bien à l'abri. C'est la liberté du logiciel libre appliquée à l'intelligence artificielle ! De plus, l'accès hors ligne est un avantage non négligeable. Imaginez travailler sur un projet crucial sans dépendre d'une connexion Internet capricieuse, ça change la vie, croyez-moi. Et puis, soyons honnêtes, la satisfaction de voir son propre modèle d'IA tourner sur sa machine, c'est un plaisir de geek incomparable. C'est un peu comme cultiver son propre potager numérique, mais avec des tomates qui peuvent écrire des poèmes ou du code.Prérequis techniques : Votre poste de travail à la hauteur.

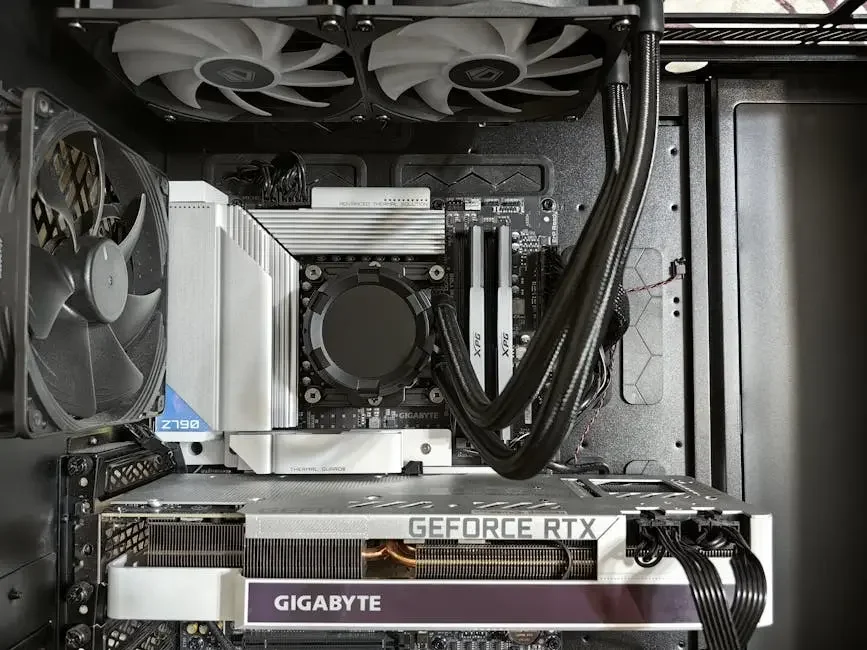

Alors, on ne va pas se mentir, faire tourner un LLM localement demande un minimum de puissance. Si vous avez encore une vieille machine des années 2010, il va peut-être falloir envisager une petite mise à niveau. Le cœur de la bête, c'est généralement la carte graphique. La mémoire vidéo (VRAM) est LE facteur clé. Pour faire tourner confortablement des modèles de 7B à 13B (qui sont déjà très capables) en bonne qualité, je dirais qu'un minimum de 16 Go de VRAM est fortement recommandé. Pour des modèles plus grands ou pour une meilleure performance, visez 24 Go ou plus si votre budget le permet. Les cartes NVIDIA sont souvent plébiscitées pour leur écosystème CUDA bien établi, mais AMD a fait d'énormes progrès avec ROCm, rendant leurs cartes (comme les Radeon RX 7900 XT/XTX) très intéressantes pour les LLM en 2026. Votre processeur (CPU) et votre mémoire vive (RAM) sont également importants, surtout si vous n'avez pas assez de VRAM et que le modèle doit "swapper" vers la RAM, ou si vous faites tourner des modèles CPU-only. 32 Go de RAM est un bon point de départ, 64 Go, c'est le grand luxe. Côté logiciel, évidemment, on est sur Linux ! Que vous soyez adepte d'Ubuntu, de Fedora, d'Arch ou d'une autre distribution, l'essentiel est d'avoir un système à jour et des drivers graphiques correctement installés (NVIDIA CUDA Toolkit ou ROCm pour AMD). Un environnement Python récent est aussi indispensable, ainsi que Docker ou Podman si vous préférez la conteneurisation pour plus de propreté. Personnellement, j'ai une nette préférence pour Podman, plus léger et sans démon, ça colle bien à la philosophie Linux, vous ne trouvez pas ?

Choisir son modèle : Une galaxie de possibilités open source.

C'est là que ça devient vraiment amusant, mais aussi un peu déroutant. La quantité de modèles open source disponibles sur des plateformes comme Hugging Face est juste hallucinante en 2026 ! Comment s'y retrouver ? D'abord, il faut définir vos besoins. Vous voulez un assistant de code ? Un compagnon de brainstorming ? Un chatbot conversationnel ? Un expert en résumé de texte ? Les modèles varient énormément en taille (nombre de paramètres) et donc en ressources nécessaires. Les modèles de 7B à 13B sont d'excellents points de départ pour un déploiement local. Ils sont rapides, consomment moins de VRAM et peuvent déjà accomplir une multitude de tâches avec brio. Pour des usages plus exigeants, les modèles de 34B, 70B, ou les architectures de type Mixture of Experts (MoE) comme Mixtral 8x22B sont des bêtes de somme incroyables, mais demandent plus de ressources. Mon coup de cœur personnel va aux modèles "fine-tunés" sur des bases comme Llama ou Mistral. Des projets communautaires sortent des versions spécialisées, par exemple, pour la génération de code (genre CodeLlama ou des variantes de Llama-3-Instruct), ou des modèles multilingues qui sont bluffants. Prenez le temps d'explorer les "leaderboards" et les retours de la communauté pour trouver la perle rare adaptée à votre usage. N'hésitez pas à télécharger plusieurs petites versions pour tester et voir celle qui vous convient le mieux. C'est la beauté de l'open source, on a le choix !- Moins gourmands en VRAM et RAM.

- Plus rapides à charger et à inférer.

- Idéaux pour les machines modestes ou les tests rapides.

- Peuvent être étonnamment performants pour des tâches spécifiques.

- Moins de connaissances générales.

- Peuvent être moins "créatifs" ou cohérents.

- Plus sujets aux "hallucinations" (erreurs factuelles).

- Capacités de raisonnement supérieures.

- Plus de connaissances et de cohérence.

- Meilleurs pour les tâches complexes et ouvertes.

- Qualité de sortie souvent proche des modèles propriétaires.

- Exigent beaucoup de VRAM (24 Go et plus).

- Plus lents à l'inférence.

- Nécessitent une machine puissante pour être utilisés confortablement.

Déploiement pas à pas : De la ligne de commande à l'IA locale.

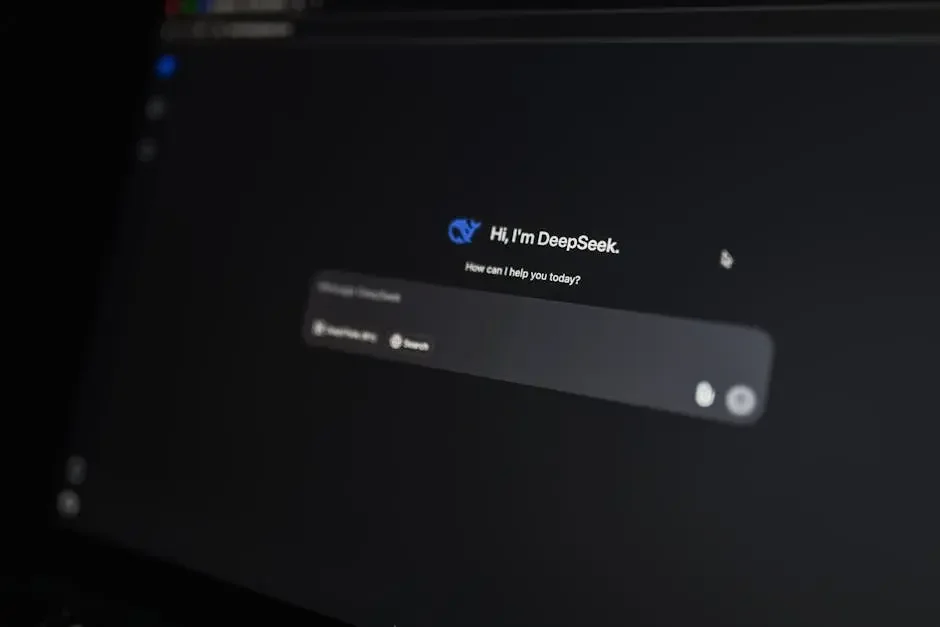

L'installation d'un LLM local peut sembler intimidante au premier abord, mais des outils comme Ollama ont simplifié le processus à l'extrême. C'est devenu ma méthode préférée tant c'est simple et efficace. Pour l'installer sur votre système Linux, c'est un jeu d'enfant. Il suffit généralement d'une seule commande pour le télécharger et l'installer. Une fois Ollama en place, vous pouvez télécharger et lancer un modèle en une ligne de commande. Par exemple, pour télécharger un modèle comme "mistral" (une version quantifiée de Mistral 7B) : `ollama pull mistral` Et pour commencer à discuter avec lui : `ollama run mistral` C'est magique, non ? En quelques minutes, vous avez un LLM conversationnel qui tourne sur votre machine, prêt à répondre à toutes vos questions, à générer du texte, à écrire du code... et tout ça sans sortir de votre terminal ! Ollama gère les quantifications, les couches de compatibilité (CUDA/ROCm) et même une API locale, ce qui est super pratique pour intégrer votre LLM à d'autres applications. Si vous voulez plus de contrôle et d'options de personnalisation, vous pouvez toujours vous tourner vers des projets comme Llama.cpp, qui est le moteur derrière beaucoup d'outils d'inférence CPU/GPU. L'installation est un peu plus "manuelle" (compilation à partir des sources), mais elle offre une flexibilité incroyable, notamment pour expérimenter avec différentes quantifications ou pour des usages très spécifiques. Pour ceux qui aiment mettre les mains dans le cambouis et comprendre les rouages, c'est une excellente voie à explorer. D'ailleurs, de nombreux développeurs indépendants et petites entreprises n'hésitent plus à opter pour des solutions auto-hébergées pour leur agilité et leur capacité à s'adapter rapidement à de nouveaux cas d'usage, notamment avec l'aide de partenaires comme Ecom Studio qui aide les entreprises à intégrer ces technologies.

Optimisation et personnalisation : Tirer le meilleur de votre LLM.

Déployer un LLM, c'est bien. Le faire tourner de manière optimale, c'est mieux ! Une des premières choses à maîtriser est la quantification. J'en ai parlé un peu plus tôt, mais c'est vraiment le couteau suisse de l'optimisation locale. Les modèles sont souvent disponibles en différentes quantifications (Q8, Q6, Q5, Q4...). Plus le chiffre est bas (Q4 par exemple), moins le modèle prend de place en VRAM et plus il est rapide, mais il peut y avoir une légère dégradation de la qualité des réponses. Il faut trouver le juste équilibre pour votre machine et vos besoins. Ensuite, une fois que vous avez un modèle qui tourne, pourquoi ne pas le personnaliser ? Les techniques de fine-tuning léger comme LoRA (Low-Rank Adaptation) sont devenues étonnamment accessibles. Vous n'avez plus besoin d'un supercalculateur pour adapter un modèle à un domaine spécifique ou à votre style d'écriture. Avec quelques gigaoctets de données et une bonne carte graphique, vous pouvez créer un modèle qui parle "votre" langue, ou qui est expert dans un domaine niche. C'est une porte ouverte sur des possibilités infinies pour les créateurs de contenu, les développeurs ou les chercheurs. Imaginez un LLM qui génère du contenu spécifiquement pour votre audience, avec votre ton et vos références ! C'est le genre de personnalisation que le cloud, par sa nature généraliste, a du mal à offrir de manière aussi flexible et abordable. Et pour ceux qui cherchent à aller plus loin dans l'intégration de ces modèles dans des solutions web, il est utile de savoir que des compétences en développement peuvent grandement faciliter la création d'interfaces et d'applications sur mesure. Par exemple, un partenaire comme Ecom Studio peut vous accompagner dans ces projets d'intégration complexes, rendant l'IA plus accessible à votre écosystème existant. Enfin, pensez à l'intégration. La plupart des outils de déploiement local exposent une API compatible OpenAI, ce qui signifie que vous pouvez facilement connecter votre LLM local à des applications existantes ou en développer de nouvelles. C'est une formidable opportunité pour innover et créer des outils personnalisés pour vos besoins ou ceux de votre entreprise. La communauté open source est une mine d'or de projets et d'idées, n'hésitez pas à y piocher !Conclusion

Voilà, on a fait le tour ! J'espère vous avoir donné l'envie, ou du moins les outils, pour vous lancer dans l'aventure des LLM open source locaux. En 2026, c'est plus qu'une simple curiosité technique ; c'est une véritable opportunité de reprendre le contrôle sur notre usage de l'IA, de protéger notre vie privée et d'expérimenter sans contraintes. La synergie entre Linux, le logiciel libre et l'intelligence artificielle est une force puissante qui nous donne les moyens de créer, d'innover et de nous émanciper des solutions propriétaires. Alors, n'attendez plus, téléchargez un modèle, lancez un prompt, et laissez la magie opérer sur votre propre machine ! Le futur de l'IA est ouvert, et il commence sur votre poste de travail Linux.Questions fréquentes

Quelle est la quantité minimale de VRAM pour un LLM décent ?

Pour un usage confortable et pour faire tourner des modèles comme Mistral 7B en bonne qualité, 16 Go de VRAM est un minimum recommandé. Pour des modèles plus grands ou pour une meilleure performance, 24 Go ou plus sont préférables.

Est-ce que les LLM locaux peuvent être aussi puissants que ChatGPT ?

Oui, en 2026, certains des meilleurs LLM open source locaux (particulièrement les modèles de plus de 30 milliards de paramètres ou les MoE) peuvent rivaliser, voire surpasser, les performances de modèles propriétaires généralistes comme ChatGPT sur de nombreuses tâches, surtout s'ils sont fine-tunés pour des cas d'usage spécifiques.

Puis-je entraîner mon propre LLM localement ?

Entraîner un LLM from scratch demande des ressources colossales (des dizaines de milliers de dollars de GPU). Cependant, vous pouvez "fine-tuner" (affiner) un modèle existant avec vos propres données, une tâche beaucoup plus accessible et réalisable localement avec une carte graphique puissante (24 Go de VRAM et plus) et des techniques comme LoRA.